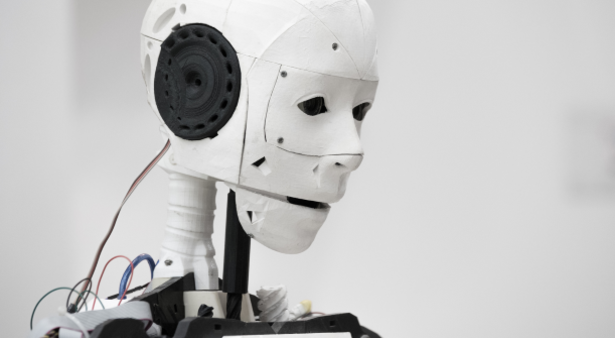

Werden wir Menschen zum Spielball der Computer?

Download

Wir haben die Materialien für Sie zum Download bereitgestellt. Bitte tragen Sie zunächst die entsprechenden Informationen in die Datenfelder ein. Es ist wichtig, dass das Formular komplett ausgefüllt wird. Mit einem Klick auf das Feld "Download" können Sie das Material direkt herunterladen. Wir garantieren Ihnen, Ihre Daten nur für interne Zwecke zu verwenden und nicht an Dritte weiterzugeben.

Vielleicht erinnern Sie sich noch an eine meiner Trendanalysen aus dem Jahr 2013. Im Vorfeld der damaligen Bundestagswahl hatte mein Trendforschungsinstitut „2b AHEAD“ in einem offenen Brief, der "Wolfsburger Erklärung", die Spitzenkandidaten aller Parteien aufgefordert, sich mit den wirklichen Zukunftsfragen zu beschäftigen. Zu den Unterzeichnern zählten neben zahlreichen Managern und Innovationschefs, auch Bundesverdienstkreuzträger und Wissenschaftsjournalisten, wie der frühere ARD-Moderator Jean Pütz. Wir hatten den Politikern die wichtigsten Zukunftsfragen in einem Katalog zusammengestellt. Die Reaktion: Keine, von keinem Politiker, aus keiner Partei!

Schade, denn hätten wir damals begonnen miteinander zu reden, wären viele heute nicht so überrascht.

Eine unserer wichtigsten Forderungen in diesem Katalog von 2013 war, alle Forschungsprojekte der Künstlichen Intelligenz zu einem „Veto-Mechanismus“ zu verpflichten, der garantiert, dass die künftigen superintelligenten Computer auch im Sinne humanistischer Moralvorstellungen entscheiden. Ansonsten drohen unberechenbare Gefahren für die Menschheit, prognostizierten wir damals.

Exakt dies ist nun, drei Jahre später, der Tenor einer internationalen Diskussion über die kommende künstliche Intelligenz. Top-Manager und Prominente von Bill Gates über Elon Musk bis Stephen Hawking haben vor der unkontrollierten Entwicklung von Superintelligenzen gewarnt. Die Forscherszene hat begonnen, über mögliche Strategien nachzudenken. Von Politikern ist dazu leider nach wie vor nichts zu hören.

Deshalb will ich heute die kleine Serie unserer Trendanalysen zur "Zukunft der Intelligenz" mit dem dritten Teil fortsetzen und abschließen. Während ich in meinen vorangegangenen Trendanalysen beschrieben habe, warum das Jahr 2016 einen neuen Durchbruch der künstlichen Intelligenz bringen wird und ob uns die Computer unsere Jobs wegnehmen, geht es heute im 3. Teil um die Kernfrage: Werden wir Menschen die kommenden übermenschlich-intelligenten Computer beherrschen können, oder steht die Existenz der Menschheit auf dem Spiel?

Auf welche Weise können wir die riesigen Chancen der kommenden übermenschlich-intelligenten Computer nutzen, ohne dabei die Existenzgrundlage unserer Kinder und Enkel zu riskieren?

Offen gestanden: Es gibt dazu auch unter Wissenschaftlern noch mehr leicht begründeten Glauben als gesicherte Antworten. Die Deterministen glauben, dass die Singularität zu einer beginnenden Verschmelzung von Mensch und Maschine führt, die eine großartige, neue Entwicklungsstufe für die Menschheit darstellt. Konstruktivisten sind sich da nicht so sicher. Sie sagen: Es hängt davon ab, wer den Code schreibt, wann und wie schnell. Und ob er sich genötigt sieht, einen Veto-Mechanismus mit einzuprogrammieren.

Ich habe Ihnen den aktuellen Stand der Debatte in dieser Trendanalyse zusammengetragen. Sie basiert im Wesentlichen auf dem Buch „Superintelligenz“ von Nick Bostrom. Meine große Empfehlung! Leider ist es keine einfache Lektüre. Aber falls Sie Zeit und Muße für 500 intensive Seiten haben, lesen Sie bitte das Original.

Falls nicht, habe ich Ihnen die Kernaussagen, kombiniert mit den wichtigsten Prognosen aus meinem 2b AHEAD ThinkTank auf 17 Seiten gebracht. Falls Sie Management Summaries von zwei Powerpoint-Slides gewohnt sind, muss ich Sie leider enttäuschen. Das geht bei diesem Thema nicht.

Sie werden lesen, dass wir an vielen Stellen heute erst dabei sind, die richtigen Fragen zu finden, bevor wir sie beantworten können. Aber so viel scheint klar zu sein: Von unseren Antworten, die wir in den kommenden 20-30 Jahren finden, hängt nicht weniger als das Weiterbestehen der Menschheit ab. Es würde sich lohnen, nun damit zu beginnen.

Doch lesen Sie am besten selbst.

Erreichen Computer übermenschliche Intelligenz?

In meinen vorangegangenen Trendanalysen: "Artificial Intelligence (Teil 1): 2016 wird das Jahr der künstlichen Intelligenz" und "Artificial Intelligence (Teil 2): Nehmen uns Computer die Arbeit weg?" habe ich versucht zu zeigen, was bei der Entwicklung der Artificial Intelligence bisher geschah und wie die Entwicklung bis zum Erreichen der allgemeinen menschlichen Intelligenz durch künftige Supercomputer weitergehen wird. Wer die weltweit besten AI-Forscherteams befragt, bekommt die Antwort, dass diese Schwelle mit hoher Wahrscheinlichkeit irgendwann zwischen den Jahren 2050 – 2090 erreicht sein wird. Soweit, so bekannt.

Doch was geschieht danach?

Sind unsere menschlichen Werte gut genug?

Damit sind wir gedanklich an einem interessanten Punkt angekommen. Natürlich erscheint es uns fundamental wichtig zu sein, den entstehenden Superintelligenzen unsere heutige, menschliche Moral mitzugeben. Doch ist das wirklich so erstrebenswert?

Sind es eigentlich wirklich die menschlichen Werte, die eine Superintelligenz vertreten sollte? Oder sind es nicht eher die übermenschlichen Werte? Sind es nicht eher jene Werte, zu denen sich die menschliche Spezies bereits hätte entwickeln sollen, aber durch ihre eigenen Unzulänglichkeiten davon abgehalten wurde?

In diese Richtung denken derzeit auch Philosophen, wenn Sie fordern, den technologischen Fortschritt nicht nur zu nutzen, um die körperlichen und geistigen Fähigkeiten von Menschen zu erweitern, sondern vor allem die moralischen. So argumentierte etwa Prof. Ingmar Persson von der University of Gothenburg auf dem 2b AHEAD Zukunftskongress 2014, dass der menschliche Körper und das menschliche Denken sich immer wieder an den technologischen Fortschritt angepasst haben, nicht aber die menschliche Moralfähigkeit. Er zog die Schlussfolgerung, dass neben den bekannten Bodyenhancement-Mitteln zur Steigerung der Leistungsfähigkeit von Körper und Hirn nunmehr an künstlichen Mitteln zur Steigerung der menschlichen Moralfähigkeit gearbeitet werden müsse.

So utopisch dieser Gedanke auch klingt, vor dem Hintergrund der entstehenden Superintelligenzen ist er wert, zu Ende gedacht zu werden. Schließlich haben unsere moralischen Überzeugungen im Laufe der Jahre dramatische Veränderungen erlebt. ‚Zum Glück!‘ würden die meisten von uns hier rufen.

Denn wer wollte heute schon in einer Zeit leben, in der etwa Hexenverbrennungen oder Massenmorde als moralisch richtig galten? Noch vor wenigen Jahren war es sogar in vielen westlichen Ländern noch moralisch in Ordnung, den Frauen das Wahlrecht zu verweigern. Und selbst heute ist es in hochentwickelten Nationen moralisch in Ordnung, Homosexuellen nicht die gleichen Rechte einzuräumen wie Heterosexuellen ... von der Todesstrafe ganz zu schweigen.

Vor diesem Hintergrund könnte es doch immerhin sein, dass wir Menschen im Jahr 2050 eine ganz andere Moralvorstellung an den Tag legen werden als heute. Und by-the-way: Ist es nicht komisch, dass wir zwar grausame Tierwettkämpfe wie Hahnenkämpfe und Stierkämpfe moralisch geächtet haben; das Boxen und Freefighting unter Menschen aber immer noch für Sport halten.

Kurz gesagt: "Höchstwahrscheinlich leiden wir auch heute noch unter der einen oder anderen schwerwiegenden moralischen Fehleinschätzung. Sich unter diesen Umständen für einen endgültigen Wert zu entscheiden, der dann für immer und ewig gilt und jeden weiteren moralischen Fortschritt unmöglich macht, hieße, eine existenzielle moralische Katastrophe zu riskieren."

Für dieses Dilemma scheint in der wissenschaftlichen Diskussion eine Lösung in Sicht zu sein. Sie heißt: Die indirekte Normativität. Sie geht davon aus, dass wir Menschen heute offensichtlich noch gar nicht wissen, was wir in Zukunft für moralisch richtig halten werden.

Falls Sie diesem Gedanken zustimmen, dann lassen Sie uns noch einen Schritt weiter gehen: Offensichtlich sehen wir Menschen ja einen Wert in der Entwicklung von Superintelligenzen. Dieser Wert besteht darin, dass diese wohl bessere, rationale Entscheidungen treffen, als wir Menschen. Anders gesagt: Die Überzeugungen einer Superintelligenz sind wohl vermutlich eher wahr, als die der Menschen. Warum sollte dies nicht auch für die moralischen Überzeugungen gelten?

Noch mehr Fragen

Ich fürchte dass dies noch nicht alle grundsätzlichen Fragen waren, auf die wir Antworten suchen. Um nur noch einige Fragen aufzuwerfen:

- Sind wir sicher, dass der heutige real-existierende Kapitalismus die geeignete Gesellschaftsform für die Zeit der Superintelligenzen ist? Immerhin konnten die Kollegen Adam Smith und Karl Marx weder von einer Superintelligenz wissen, noch von der dadurch marginalisierten Bedeutung der menschlichen Arbeit. Haben wir also neben den Klassikern des Kapitalismus, Sozialismus und Kommunismus noch weitere Ideen für die Form des Zusammenlebens auf der Erde?

- Wie soll eine menschliche Regierung regieren und eine gesellschaftliche Willensbildung erfolgen, wenn die Superintelligenz sowieso bessere Entscheidungen trifft?

- Welches Rechtssystem würde der Ära der Superintelligenzen entsprechen?

- Wie gewährleisten wir den Schutz der Individualität und der Minderheitenrechte, wenn zu jeder Frage permanent eine weltweite Volksabstimmung möglich ist und darüber hinaus diese Weltabstimmung eigentlich unnötig ist, weil ihr Ergebnis von der Superintelligenz auch vorausberechnet werden kann?

- Wie bewahren wir das Recht der Menschen auf Überraschung und Unvernunft?

- Wie sichern wir unser Recht auf Spontanität in Zeiten permanenter Prognose?

- Und nicht zuletzt: Wie organisieren wir Menschen das Sterben, wenn uns die Technologie die Möglichkeiten zum nahezu "ewigen Leben" schafft?

Wir wünschen Ihnen eine große Zukunft!